I takt med att bärbar datoranvändning utvecklas i halsbrytande fart,AI-glasögonframträder som en kraftfull ny frontlinje. I den här artikeln ska vi utforska hur AI-glasögon fungerar – vad som får dem att fungera – från sensorhårdvaran till de inbyggda och molnbaserade hjärnorna, till hur din information levereras sömlöst. PåWellyp Audio, vi tror att förståelse för tekniken är nyckeln till att skapa verkligt differentierade, högkvalitativa AI-glasögon (och tillhörande ljudprodukter) för den globala marknaden.

1. Trestegsmodellen: Input → Processing → Output

När vi säger Hur det fungerar: tekniken bakom AI-glasögon, är det enklaste sättet att beskriva det som ett flöde av tre steg: Input (hur glasögonen känner av världen), Processing (hur data tolkas och omvandlas) och Output (hur den intelligensen levereras till dig).

Många av dagens system använder denna tredelade arkitektur. Till exempel, i en nyligen publicerad artikel står det: AI-glasögon fungerar enligt en trestegsprincip: Input (insamling av data via sensorer), Processing (användning av AI för att tolka data) och Output (leverans av information via en skärm eller ljud).

I följande avsnitt kommer vi att gå igenom varje steg på djupet, lägga till de viktigaste teknologierna, designavvägningarna och hur Wellyp Audio tänker kring dem.

2. Inmatning: avkänning och anslutning

Den första stora fasen i ett AI-glasögonsystem är att samla in information från världen och från användaren. Till skillnad från en smartphone som du pekar och lyfter upp, syftar AI-glasögon till att alltid vara påslagna, kontextmedvetna och sömlöst integrerade i ditt dagliga liv. Här är huvudelementen:

2.1 Mikrofonuppsättning och röstinmatning

En högkvalitativ mikrofonuppsättning är en viktig ingångskanal. Den möjliggör röstkommandon (Hej Glasögon, översätt den här frasen, Vad säger den där skylten?), interaktion i naturligt språk, direkttextning eller översättning av samtal, och omgivningslyssning för sammanhang. Till exempel förklarar en källa:

En högkvalitativ mikrofonuppsättning … är utformad för att fånga dina röstkommandon tydligt, även i bullriga miljöer, så att du kan ställa frågor, anteckna eller få översättningar.

Ur Wellyps perspektiv ser vi mikrofonsystemet inte bara som talinspelning utan även omgivningsljudinspelning för kontextmedvetenhet, brusreducering och till och med framtida rumsliga ljudfunktioner när vi designar en AI-glasögonprodukt med tillhörande ljud (t.ex. TWS-hörlurar eller en kombination av over-ear och glasögon).

2.2 IMU och rörelsesensorer

Rörelseavkänning är avgörande för glasögon: den spårar huvudets orientering, rörelser, gester och stabilitet hos överlagringar eller skärmar. IMU (inertial measurement unit) – som vanligtvis kombinerar accelerometer + gyroskop (och ibland magnetometer) – möjliggör rumslig medvetenhet. En artikel anger:

En IMU är en kombination av en accelerometer och ett gyroskop. Denna sensor spårar ditt huvuds orientering och rörelse. … Denna AI-glasögonteknik är grundläggande för funktioner som kräver rumslig medvetenhet.” I Wellyps designtänkande möjliggör IMU:

● stabilisering av alla skärmar på linsen när bäraren rör sig

● gestdetektering (t.ex. nickning, skakning, lutning)

● miljömedvetenhet (i kombination med andra sensorer)

● Energioptimerad sömn-/vakenhetsdetektering (t.ex. av-/påtagning av glasögon)

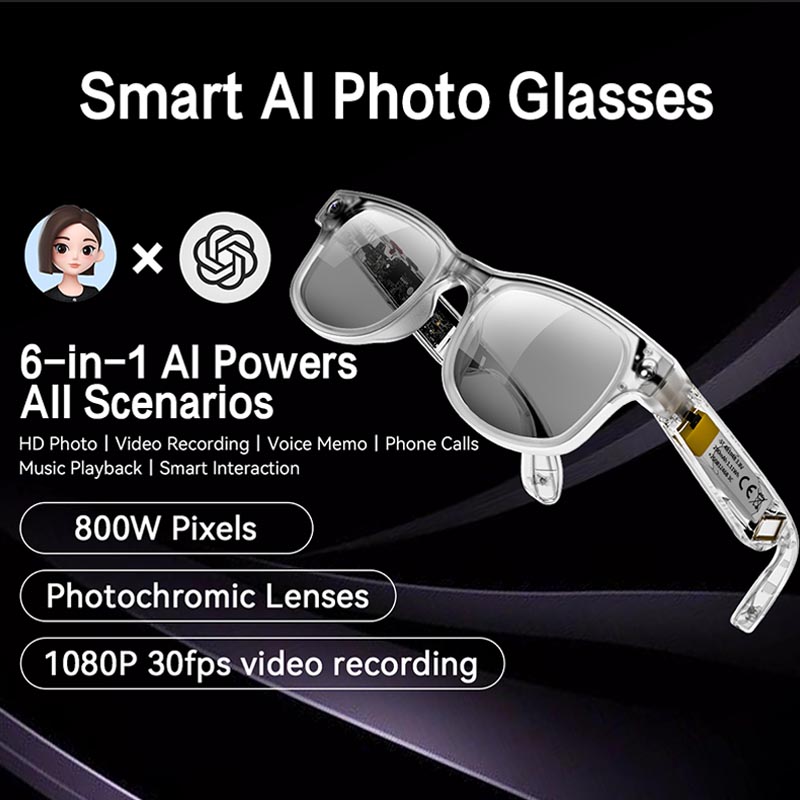

2.3 (Valfritt) Kamera / Visuella sensorer

Vissa AI-glasögon inkluderar utåtriktade kameror, djupsensorer eller till och med moduler för scenigenkänning. Dessa möjliggör datorseendefunktioner som objektigenkänning, översättning av text i sikte, ansiktsigenkänning, miljökartläggning (SLAM) etc. En källa noterar:

Smarta glasögon för synskadade använder AI för objekt- och ansiktsigenkänning … glasögonen stöder navigering via platstjänster, Bluetooth och inbyggda IMU-sensorer.

Kameror ökar dock kostnaden, komplexiteten, strömförbrukningen och ger upphov till integritetsproblem. Många enheter väljer en arkitektur som prioriterar integritet genom att utelämna kameran och istället förlita sig på ljud- och rörelsesensorer. På Wellypaudio kan vi, beroende på målmarknaden (konsument kontra företag), välja att inkludera en kameramodul (t.ex. 8–13 MP) eller utelämna den för lätta, billiga modeller med fokus på integritet.

2.4 Konnektivitet: länkning till det smarta ekosystemet

AI-glasögon är sällan helt fristående – snarare är de en förlängning av din smartphone eller ditt trådlösa ljudekosystem. Anslutning möjliggör uppdateringar, tyngre bearbetning utanför enheten, molnfunktioner och kontroll av användarappar. De typiska länkarna:

● Bluetooth LE: alltid påslagen lågströmslänk till telefonen för sensordata, kommandon och ljud.

● Wi-Fi/mobilinternetdelning: för tyngre uppgifter (AI-modellförfrågningar, uppdateringar, streaming)

● Medföljande app: på din smartphone för anpassning, analyser, inställningar och datagranskning

Ur ett Wellyp-perspektiv innebär integration med vårt TWS/over-ear-ekosystem sömlös växling mellan glasögon + hörlursljud, smart assistent, översättning eller omgivande lyssningslägen och firmwareuppdateringar trådlöst.

2.5 Sammanfattning – varför input är viktigt

Kvaliteten på ingångssystemet sätter grunden: bättre mikrofoner, renare rörelsedata, robust anslutning, genomtänkt sensorfusion = bättre upplevelse. Om dina glasögon hör kommandon fel, detekterar huvudrörelser fel eller laggar på grund av anslutningsproblem, blir upplevelsen lidande. Wellyp betonar designen av ingångssystemet som en grund för avancerade AI-glasögon.

3. Bearbetning: hjärnor i enheter och molnintelligens

När glasögonen har samlat in information är nästa fas att bearbeta den informationen: tolka röst, identifiera sammanhang, bestämma vilket svar som ska ges och förbereda utdata. Det är här "AI" i AI-glasögon tar plats i centrum.

3.1 Beräkning på enheten: System-on-Chip (SoC)

Moderna AI-glasögon inkluderar en liten men kapabel processor – ofta kallad system-on-chip (SoC) eller dedikerad mikrokontroller/NPU – som hanterar ständigt påslagna uppgifter, sensorfusion, röstnyckelordsdetektering, väckordslyssning, grundläggande kommandon och lokala svar med låg latens. Som en artikel förklarar:

Varje par AI-glasögon innehåller en liten, strömsnål processor, ofta kallad System on a Chip (SoC). … Detta är den lokala hjärnan som ansvarar för att köra enhetens operativsystem – hantera sensorerna och hantera grundläggande kommandon.

Wellyps designstrategi inkluderar att välja en SoC med låg effekt som stöder:

● röstnyckelords-/väckningsordsdetektering

● lokal NLP för enkla kommandon (t.ex. ”Vad är klockan?”, ”Översätt den här meningen”)

● sensorfusion (mikrofon + IMU + valfri kamera)

● anslutnings- och energihanteringsuppgifter

Eftersom effekt och formfaktor är avgörande för glasögon måste den inbyggda SoC:n vara effektiv, kompakt och generera minimal värme.

3.2 Hybrid lokal vs. molnbaserad AI-bearbetning

För mer komplexa frågor – t.ex. "Översätt den här konversationen i realtid", "Sammanfatta mitt möte", "Identifiera det här objektet" eller "Vad är den bästa vägen för att undvika trafik?" – görs det tunga arbetet i molnet där stora AI-modeller, neurala nätverk och stora beräkningskluster finns tillgängliga. Avvägningen är latens, anslutningskrav och integritet. Som nämnts:

En viktig del är att bestämma var en begäran ska behandlas. Detta beslut balanserar hastighet, integritet och makt.

● Lokal bearbetning: Enkla uppgifter hanteras direkt på glasögonen eller på din anslutna smartphone. Detta är snabbare, använder mindre data och håller din information privat.

● Molnbehandling: För komplexa frågor som kräver avancerade generativa AI-modeller … skickas begäran till kraftfulla servrar i molnet. … Denna hybridmetod möjliggör kraftfulla AI-glasögon utan att kräva en massiv, strömslukande processor inuti bågarna.

Wellyps arkitektur konfigurerar denna hybridbehandlingsmodell enligt följande:

● Använd lokal bearbetning för sensorfusion, väckningsordsdetektering, grundläggande röstkommandon och offline-översättning (liten modell)

● För avancerade frågor (t.ex. flerspråkig översättning, bildigenkänning (om kamera finns), generativa svar, kontextuella förslag), skicka till molnet via smartphone eller WiFi.

● Säkerställ datakryptering, minimal latens, reservupplevelse offline och funktioner som är inriktade på användarintegritet.

3.3 Programvaruekosystem, tillhörande app och firmware

Bakom hårdvaran finns en mjukvaruuppsättning: ett lättviktigt operativsystem på glasögonen, en tillhörande smartphone-app, molnbaserad backend och tredjepartsintegrationer (röstassistenter, översättningsmotorer, företags-API:er). Som en artikel beskriver:

Den sista pusselbiten är programvaran. Glasögonen kör ett lätt operativsystem, men de flesta inställningar och anpassningar sker i en tillhörande app på din smartphone. Den här appen fungerar som kommandocentral – så att du kan hantera aviseringar, anpassa funktioner och granska information som fångats upp av glasögonen.

Från Wellyps synvinkel:

● Säkerställ att firmwareuppdateringar sker OTA (over the air) för framtida funktioner

● Tillåt att den kompletterande appen hanterar användarinställningar (t.ex. språkinställningar, aviseringstyper, ljudjustering)

● Tillhandahåll analyser/diagnostik (batterianvändning, sensorhälsa, anslutningsstatus)

● Upprätthåll robusta integritetspolicyer: data lämnar endast enheten eller smarttelefonen med tydligt samtycke från användaren.

4. Resultat: leverans av information

Efter inmatning och bearbetning skapas den sista delen av resultatet – hur glasögonen levererar intelligens och feedback till dig. Målet är att vara sömlös, intuitiv och minimalt störande för dina primära uppgifter att se och höra världen.

4.1 Visuell utgång: Head-Up Display (HUD) och vågledare

En av de mest synliga teknologierna i AI-glasögon är displaysystemet. I stället för en stor skärm använder bärbara AI-glasögon ofta en transparent visuell överlagring (HUD) genom projektion eller vågledarteknik. Till exempel:

Den mest märkbara funktionen hos AI-smarta glasögon är den visuella displayen. Istället för en solid skärm använder AI-glasögon ett projektionssystem för att skapa en transparent bild som verkar flyta i ditt synfält. Detta uppnås ofta med mikro-OLED-projektorer och vågledarteknik, som leder ljus över linsen och riktar det mot ditt öga.

En användbar teknisk referens: företag som Lumus specialiserar sig på vågledaroptik som används för AR/AI-glasögon.

Viktiga överväganden för Wellyp vid utformning av det optiska utgångssystemet:

● Minimalt hinder för verklighetsbilden

● Hög ljusstyrka och kontrast så att överlagringen förblir synlig i dagsljus

● Tunna linser/bågar för att bibehålla estetik och komfort

● Synfältsbalans mellan läsbarhet och bärbarhet

● Integrering med receptbelagda linser vid behov

● Minimal strömförbrukning och värmeutveckling

4.2 Ljudutgång: öppenöra, benledningshögtalare eller högtalare i tinningen

För många AI-glasögon (särskilt när ingen skärm finns) är ljud den primära kanalen för feedback – röstsvar, aviseringar, översättningar, omgivningslyssning etc. Två vanliga metoder:

● Högtalare i templet: små högtalare inbäddade i armarna, riktade mot örat. Nämns i en artikel:

För modeller utan inbyggd display används ljudsignaler … vanligtvis via små högtalare som är placerade i glasögonens skalmar.

● Benledning**: överför ljud genom skallbenen och lämnar hörselgångarna öppna. Vissa moderna bärbara enheter använder detta för situationsmedvetenhet. Till exempel:

Ljud och mikrofoner: Ljud levereras via dubbla benledningshögtalare …

Ur Wellyps audiocentrerade perspektiv betonar vi:

● Högkvalitativt ljud (tydligt tal, naturlig röst)

● Låg latens för interaktioner med röstassistenten

● Bekväm öppen örondesign som bevarar omgivningsmedvetenheten

● Sömlös växling mellan glasögon och trådlösa hörlurar (TWS) eller over-ear-hörlurar som vi tillverkar

4.3 Haptisk/vibrationsåterkoppling (valfritt)

En annan utdatakanal, särskilt för diskreta aviseringar (t.ex. Du har en översättning redo) eller varningar (lågt batteri, inkommande samtal) är haptisk feedback via bågen eller hörlurarna. Även om det är mindre vanligt i vanliga AI-glasögon ännu, betraktar Wellyp haptiska signaler som en kompletterande modalitet i produktdesign.

4.4 Resultatupplevelse: att blanda den verkliga och digitala världen

Nyckeln är att blanda in digital information i din verkliga kontext utan att dra dig ur ögonblicket. Till exempel att lägga över textning medan du pratar med någon, visa navigationsledtrådar i linsen medan du går eller ge ljudmeddelanden medan du lyssnar på musik. Effektiva AI-glasögon tar hänsyn till din omgivning: minimal distraktion, maximal relevans.

5. Avvägningar mellan ström, batteri och formfaktor

En av de största tekniska utmaningarna med AI-glasögon är energisparande och miniatyrisering. Lätta, bekväma glasögon kan inte rymma de stora batterierna i smartphones eller AR-headset. Några viktiga överväganden:

5.1 Batteriteknik och inbyggd design

AI-glasögon använder ofta specialformade litiumpolymerbatterier (LiPo) inbäddade i bågarnas armar. Till exempel:

AI-glasögon använder specialformade litiumpolymerbatterier (LiPo) med hög densitet. Dessa är små och lätta nog att bäddas in i glasögonens skalmar utan att lägga till för mycket volym eller vikt. ([Even Realities][1])

Designavvägningar för Wellyp: batterikapacitet kontra vikt kontra komfort; avvägningar vid drifttid kontra standby; värmeavledning; ramtjocklek; utbytbarhet kontra förseglad design.

5.2 Förväntad batteritid

På grund av storleksbegränsningar och funktioner som alltid är på (mikrofoner, sensorer, anslutning) mäts batteritiden ofta i timmar av aktiv användning snarare än en hel dag med tunga uppgifter. En artikel noterar:

Batteritiden varierar beroende på användning, men de flesta AI-glasögon är utformade för att hålla i flera timmar vid måttlig användning, vilket inkluderar enstaka AI-frågor, aviseringar och ljuduppspelning.

Wellyps mål: design för minst 4–6 timmars blandad användning (röstfrågor, översättning, ljuduppspelning) med en heldags standbytid; i premiumdesigner, öka till 8+ timmar.

5.3 Laddnings- och tillbehörsfodral

Många glasögon inkluderar ett laddningsfodral (särskilt TWS-hörlurarhybrider) eller en dedikerad laddare för glasögon. Dessa kan komplettera batteriet i enheten, möjliggöra enklare bärbarhet och skydda enheten när den inte används. Vissa designer inom glasögon börjar använda laddningsfodral eller dockningsstationer. Wellyps produktplan inkluderar ett valfritt laddningsfodral för AI-glasögon, särskilt i kombination med våra TWS-produkter.

5.4 Formfaktor, komfort och vikt

Om man inte designar för komfort kommer de bästa AI-glasögonen att stå oanvända. Viktigt:

● Målvikt helst < 50 g (endast för glasögon)

● Balanserad ram (så att armarna inte dras framåt)

● Linsalternativ: klara, solglasögon, kompatibel med receptbelagda glas

● Ventilation/värmeavledning för processmodul

● Stil och estetik i linje med konsumenternas preferenser (glasögon måste se ut som glasögon)

Wellyp samarbetar med erfarna OEM-partners för glasögon för att optimera formfaktorn samtidigt som de tar hänsyn till sensor-, batteri- och anslutningsmoduler.

6. Sekretess-, säkerhets- och regelöverväganden

Vid utformning av AI-glasögonteknik måste inmatnings- → bearbetnings- → utmatningskedjan också ta hänsyn till integritet, säkerhet och regelefterlevnad.

6.1 Kamera kontra ingen kamera: avvägningar gällande integritet

Som nämnts öppnar en kamera upp för många möjligheter (objektigenkänning, sceninspelning) men ger också upphov till integritetsproblem (inspelning av åskådare, juridiska frågor). En artikel lyfter fram:

Många smarta glasögon använder en kamera som primär ingång. Detta ger dock upphov till betydande integritetsproblem ... Genom att förlita sig på ljud- och rörelseingångar ... fokuserar den på AI-driven assistans ... utan att spela in din omgivning.

På Wellyp betraktar vi två nivåer:

● En modell med fokus på integritet utan utåtriktad kamera men med högkvalitativt ljud/IMU för översättning, röstassistent och omgivningsmedvetenhet

● En premiummodell med kamera-/visionssensorer, men med mekanismer för användarsamtycke, tydliga indikatorer (LED-lampor) och robust arkitektur för dataintegritet

6.2 Datasäkerhet och anslutning

Uppkoppling innebär molnlänkar; detta medför risker. Wellyp implementerar:

● Säker Bluetooth-parning och datakryptering

● Säkra firmwareuppdateringar

● Användarsamtycke för molnfunktioner och datadelning

● Tydlig integritetspolicy och möjlighet för användaren att välja bort molnfunktioner (offline-läge)

6.3 Regelverk/säkerhetsaspekter

Eftersom glasögon kan bäras under promenader, pendling eller till och med bilkörning, måste designen följa lokala lagar (t.ex. begränsningar för visning av glasögon under bilkörning). En FAQ noterar:

Kan man köra bil med AI-glasögon? Det beror på lokala lagar och den specifika enheten.

Dessutom måste optisk utgång undvika att skymma synen, orsaka ögonansträngning eller säkerhetsrisk; ljudet måste upprätthålla omgivningsmedvetenhet; batteriet måste uppfylla säkerhetsstandarder; materialen måste uppfylla föreskrifterna för bärbar elektronik. Wellyps efterlevnadsteam säkerställer att vi uppfyller CE-, FCC-, UKCA- och andra tillämpliga regionspecifika föreskrifter.

7. Användningsfall: vad dessa AI-glasögon möjliggör

Att förstå tekniken är en sak; att se de praktiska tillämpningarna gör det övertygande. Här är representativa användningsfall för AI-glasögon (och var Wellyp fokuserar):

● Språköversättning i realtid: Konversationer på främmande språk översätts direkt och levereras via ljud- eller bildöverlagring

● Röstassistent alltid på: Handsfree-frågor, anteckningar, påminnelser, kontextuella förslag (t.ex. Du är nära det där kaféet du gillade)

● Livetextning/transkription: För möten, föreläsningar eller samtal – AI-glasögon kan texta tal i örat eller på linsen

● Objektigenkänning och kontextmedvetenhet (med kameraversion): Identifiera objekt, landmärken, ansikten (med tillstånd) och ge ljud- eller bildkontext

● Navigering och förstärkning: Gångvägsanvisningar överlagrade på linsen; ljuduppmaningar för vägbeskrivningar; heads-up-aviseringar

● Hälsa/träning + ljudintegration: Eftersom Wellyp specialiserar sig på ljud innebär kombinationen av glasögon med TWS/over-ear-hörlurar en sömlös övergång: rumsliga ljudsignaler, miljömedvetenhet plus en AI-assistent när du lyssnar på musik eller en podcast.

● Företags-/industriella användningsområden: Handsfree-checklistor, lagerlogistik, fältservicetekniker med instruktioner på överlägg

Genom att samordna våra ekosystem för hårdvara, mjukvara och ljud strävar Wellyp efter att leverera AI-glasögon som betjänar både konsument- och företagssegment med hög prestanda och sömlös användbarhet.

8. Vad som skiljer Wellyp Audios vision från andra

Som tillverkare specialiserad på anpassning och grossisttjänster tillför Wellyp Audio specifika styrkor till AI-glasögonområdet:

● Ljud + integrering av bärbara enheter: Vårt erfarna arbete inom ljudprodukter (TWS, over-ear, USB-ljud) innebär att vi erbjuder avancerad ljudingång/-utgång, brusreducering, open-ear-design och synkronisering av ljud.

● Modulär anpassning och OEM-flexibilitet: Vi specialiserar oss på anpassning – ramdesign, sensormoduler, färgsättningar, varumärkesbyggande – perfekt för grossist-/B2B-partners

● Helhetsinriktad tillverkning för trådlösa/BT-ekosystem: Många AI-glasögon kan paras ihop med öronsnäckor eller over-ear-hörlurar. Wellyp täcker redan dessa kategorier och kan leverera ett komplett ekosystem.

● Global marknadserfarenhet: Med målmarknader som inkluderar Storbritannien och andra områden förstår vi regional certifiering, distributionsutmaningar och konsumentpreferenser.

● Fokus på hybridbehandling och integritet: Vi anpassar produktstrategin till hybridmodellen (på enheten + molnet) och erbjuder konfigurerbara varianter med/utan kamera för olika kundprioriteringar.

Kort sagt: Wellyp Audio är positionerat inte bara för att producera AI-glasögon, utan för att leverera ett ekosystem för bärbara enheter kring AI-assisterade glasögon, ljud, uppkoppling och programvara.

9. Vanliga frågor (FAQ)

F: Behöver AI-glasögon en konstant internetanslutning?

A: Nej – för grundläggande uppgifter räcker lokal bearbetning. För avancerade AI-frågor (stora modeller, molnbaserade tjänster) behöver du anslutning.

F: Kan jag använda receptbelagda linser med AI-glasögon?

A: Ja – många modeller stöder receptbelagda eller specialanpassade linser, med optiska moduler utformade för att integrera olika linsstyrkor.

F: Kommer det att distrahera mig när jag kör bil eller går om jag använder AI-glasögon?

A: Det beror på. Skärmen får inte vara störande, ljudet bör upprätthålla omgivningsmedvetenhet och lokala lagar varierar. Prioritera säkerhet och kontrollera föreskrifter.

F: Hur länge kommer batteriet att hålla?

A: Det beror på användningen. Många AI-glasögon siktar på "flera timmar" av aktiv användning – vilket inkluderar röstfrågor, översättning och ljuduppspelning. Standbytiden är längre.

F: Är AI-glasögon bara AR-glasögon?

A: Inte exakt. AR-glasögon fokuserar på att lägga grafik över världen. AI-glasögon betonar intelligent assistans, kontextmedvetenhet och röst-/ljudintegration. Hårdvaran kan överlappa varandra.

Tekniken bakom AI-glasögon är en fascinerande orkestrering av sensorer, uppkoppling, datoranvändning och människocentrerad design. Från mikrofonen och IMU som fångar din omvärld, via hybrid lokal/molnbaserad bearbetning av data, till skärmar och ljud som levererar intelligens – så här fungerar framtidens smarta glasögon.

På Wellyp Audio är vi glada att kunna förverkliga denna vision: genom att kombinera vår expertis inom ljud, tillverkning av bärbara enheter, anpassningsmöjligheter och globala marknadsnärvaro. Om du vill bygga, varumärkesbygga eller sälja AI-glasögon (eller tillhörande ljudutrustning) är det viktigt att förstå hur det fungerar: tekniken bakom AI-glasögon.

Håll utkik efter Wellyps kommande produktlanseringar inom detta område – som omdefinierar hur du ser, hör och interagerar med din omvärld.

Redo att utforska skräddarsydda bärbara smarta glasögonlösningar? Kontakta Wellypaudio idag för att upptäcka hur vi kan samdesigna era nästa generations AI- eller AR-smarta glasögon för den globala konsument- och grossistmarknaden.

Rekommendera läsning

Publiceringstid: 8 november 2025